Einleitung: Wenn Algorithmen auf Rasen treffen

Samstagnachmittag, fünfzehn Uhr dreißig. In deutschen Wohnzimmern flimmern die Bundesliga-Konferenzen über die Bildschirme, während gleichzeitig Millionen von Menschen versuchen, das Unvorhersehbare vorherzusagen. Der Reiz, das nächste Tor zu erahnen oder den Überraschungssieger zu erkennen, ist so alt wie der Fußball selbst. Generationen von Fans haben sich an diesem Unterfangen versucht, haben Tabellen studiert, Statistiken gewälzt und nicht selten auf das berüchtigte Bauchgefühl gehört, das einen dann doch zum falschen Tipp verleitet hat. Doch während frühere Generationen auf Expertenmeinungen, Tabellenkonstellationen und eben jenes trügerische Bauchgefühl setzten, hat sich in den vergangenen Jahren ein neuer Mitspieler auf das Feld geschlichen: die künstliche Intelligenz. Und dieser Mitspieler bringt einiges an Gepäck mit – Terabytes an Daten, komplexe Algorithmen und das Versprechen, den Zufall wenn schon nicht zu besiegen, so doch wenigstens besser zu verstehen.

Die Idee, Spielausgänge mithilfe von Computern zu berechnen, ist dabei keineswegs neu. Bereits in den Achtzigerjahren experimentierten Statistiker mit einfachen Modellen, um Fußballergebnisse zu prognostizieren. Was sich jedoch grundlegend verändert hat, ist die schiere Menge an verfügbaren Daten und die Rechenleistung, um diese zu verarbeiten. Wo früher bestenfalls Tabellenplätze und Torverhältnisse in eine Formel einflossen, analysieren moderne KI-Systeme Hunderte von Variablen – von der Passgenauigkeit einzelner Spieler über die Laufleistung bis hin zu Wetterbedingungen und historischen Direktvergleichen. Das klingt zunächst beeindruckend, wirft aber auch eine zentrale Frage auf: Kann ein Algorithmus wirklich verstehen, was auf dem Rasen passiert?

Die Antwort darauf ist, wie so oft bei komplexen Themen, ein klares Jein. Einerseits erreichen die besten KI-Systeme Trefferquoten, die deutlich über dem Zufallsniveau liegen. Manche Modelle schaffen es, in mehr als sechs von zehn Fällen den Spielausgang korrekt vorherzusagen – klingt vielleicht nicht weltbewegend, ist aber in einem Sport mit drei möglichen Ergebnissen und enormer Varianz durchaus beachtlich. Andererseits bleibt Fußball ein Spiel voller Unwägbarkeiten – der abgefälschte Schuss, der Elfmeter in der Nachspielzeit, der Platzverweis aus heiterem Himmel, die plötzliche Formschwäche eines Schlüsselspielers oder die unerwartete taktische Umstellung des Trainers. Diese Momente lassen sich nicht berechnen, und genau das macht den Sport ja auch so faszinierend. Die KI ist also weniger ein allwissendes Orakel als vielmehr ein Werkzeug, das dabei helfen kann, Wahrscheinlichkeiten besser einzuschätzen und fundierter zu argumentieren. Nicht mehr, aber eben auch nicht weniger.

In diesem Artikel tauchen wir tief in die Welt der KI-gestützten Fußballvorhersagen ein. Wir schauen uns an, welche Technologien dahinterstecken, woher die Daten kommen und wie man als interessierter Nutzer die Qualität verschiedener Anbieter einschätzen kann. Dabei geht es nicht darum, den Lesern das sichere System für garantierte Gewinne zu versprechen – wer das behauptet, lügt entweder oder hat das Grundprinzip von Wahrscheinlichkeiten nicht verstanden. Stattdessen wollen wir ein realistisches Bild davon zeichnen, was KI im Fußballkontext leisten kann, wo ihre Grenzen liegen und wie man ihre Erkenntnisse sinnvoll für eigene Einschätzungen nutzen kann. Denn eines ist sicher: Die Technologie wird nicht wieder verschwinden, und wer sie versteht, kann sie zu seinem Vorteil nutzen.

Grundlagen: Was steckt hinter KI-Fußballvorhersagen

Bevor wir uns in die Details stürzen, lohnt sich ein Blick auf die Grundlagen. Der Begriff künstliche Intelligenz wird in der öffentlichen Diskussion oft inflationär verwendet, und nicht alles, was als KI verkauft wird, verdient diese Bezeichnung auch. Im Kern geht es bei KI um Systeme, die in der Lage sind, aus Daten zu lernen und auf Basis dieses Lernens Entscheidungen zu treffen oder Vorhersagen zu machen. Das unterscheidet sie fundamental von klassischen Computerprogrammen, die starre Regeln befolgen. Eine KI entwickelt ihre Regeln gewissermaßen selbst, indem sie Muster in historischen Daten erkennt.

Bei Fußballvorhersagen kommen verschiedene Spielarten von KI zum Einsatz, und die Unterschiede sind durchaus relevant für die Qualität der Ergebnisse. Die einfachste Form sind regelbasierte Systeme, die man streng genommen gar nicht als echte KI bezeichnen sollte. Sie werten vorhandene Statistiken nach festgelegten Kriterien aus – etwa indem sie Teams nach ihrer Heimbilanz oder der Anzahl erzielter Tore ranken und daraus mechanisch einen Tipp ableiten. Wenn Team A mehr Tore schießt als Team B, gewinnt Team A – so simpel, so begrenzt. Solche Systeme sind transparent und nachvollziehbar, stoßen aber schnell an ihre Grenzen, wenn es um komplexere Zusammenhänge geht. Der Fußball folgt eben nicht immer einfachen Wenn-Dann-Regeln, und ein System, das das ignoriert, wird regelmäßig daneben liegen. Die nächste Stufe bildet das maschinelle Lernen, bei dem Algorithmen selbstständig Korrelationen in Daten finden, ohne dass ein Mensch diese Zusammenhänge explizit programmiert hätte. Ein solches System könnte beispielsweise erkennen, dass Teams mit hoher Ballbesitzquote gegen tief stehende Gegner statistisch häufiger Schwierigkeiten haben – ein Zusammenhang, der einem menschlichen Beobachter vielleicht entgeht oder zumindest nicht quantifizierbar wäre. Das Faszinierende daran: Die Maschine entdeckt diese Muster ganz von selbst, indem sie Tausende von Spielen analysiert und nach Gemeinsamkeiten sucht.

Noch einen Schritt weiter gehen Deep-Learning-Modelle, die auf künstlichen neuronalen Netzen basieren. Diese Systeme können extrem komplexe Muster erkennen, indem sie Daten durch mehrere Schichten von Verarbeitungseinheiten schicken. Der Nachteil: Was genau in diesen Schichten passiert, ist selbst für die Entwickler oft nicht mehr vollständig nachvollziehbar. Man spricht hier vom Black-Box-Problem – die KI liefert Ergebnisse, aber die Begründung dafür bleibt im Dunkeln. Für Sportwetten kann das problematisch sein, denn wer nicht versteht, warum ein System eine bestimmte Vorhersage trifft, kann auch nicht einschätzen, wann diese Vorhersage besonders zuverlässig oder eben unsicher ist.

In jüngster Zeit haben auch große Sprachmodelle wie ChatGPT oder Claude den Weg in die Sportwetten-Szene gefunden. Diese Systeme wurden ursprünglich für ganz andere Aufgaben entwickelt, können aber mit entsprechenden Eingaben auch Fußballanalysen erstellen. Ihre Stärke liegt in der Fähigkeit, verschiedene Informationsquellen zu kombinieren und in verständlicher Sprache zusammenzufassen. Der entscheidende Nachteil: Sie haben keinen Echtzeit-Zugang zu aktuellen Daten und neigen dazu, bei Faktenfragen zu halluzinieren – also überzeugend klingende Aussagen zu machen, die schlicht falsch sind. Für Vorhersagen, die auf aktuellen Statistiken basieren müssen, sind sie daher nur bedingt geeignet, können aber als Ergänzung zu spezialisierten Tools durchaus nützlich sein.

Die Datenbasis: Woraus die KI ihre Weisheit schöpft

Die Qualität jeder KI-Vorhersage steht und fällt mit der Qualität der zugrunde liegenden Daten. Dieser Grundsatz, in der Informatik als Garbage In, Garbage Out bekannt, gilt für Fußballprognosen in besonderem Maße. Ein noch so ausgeklügelter Algorithmus kann keine brauchbaren Ergebnisse liefern, wenn er mit unvollständigen, veralteten oder schlicht falschen Informationen gefüttert wird. Das klingt banal, wird in der Praxis aber erstaunlich oft ignoriert. Manche Anbieter werben mit beeindruckenden KI-Methoden, verschweigen aber, dass ihre Datenbasis löchrig ist wie ein Schweizer Käse. Deshalb lohnt sich ein genauer Blick darauf, welche Datenquellen moderne KI-Systeme eigentlich nutzen und wo die Grenzen dieser Informationen liegen.

Die Basis bilden in der Regel historische Spieldaten: Ergebnisse, Torschützen, Spielminuten der Treffer, Platzverweise und Ähnliches. Diese Informationen sind öffentlich zugänglich und werden von zahlreichen Anbietern gesammelt. Für eine seriöse Analyse reichen sie allein jedoch nicht aus. Die nächste Ebene umfasst detaillierte Spielstatistiken, wie sie von professionellen Datendienstleistern wie Opta, StatsBomb oder Wyscout erfasst werden. Hier geht es um Kennzahlen wie Ballbesitz, Passgenauigkeit, gewonnene Zweikämpfe, Schüsse aufs Tor und deren Positionen auf dem Spielfeld. Diese Daten werden teilweise manuell von geschulten Beobachtern erfasst, teilweise automatisch durch Tracking-Systeme in den Stadien generiert.

Besonders wertvoll sind sogenannte Event-Daten, die jeden einzelnen Ballkontakt in einem Spiel dokumentieren. Wer hat wann den Ball wohin gespielt? Aus welcher Position wurde geschossen? Wie viele Gegenspieler befanden sich im Schussweg? Wie schnell bewegte sich der Ball? War es ein Direktschuss oder kontrollierte der Spieler den Ball vorher? Diese granularen Informationen ermöglichen Berechnungen wie die Expected Goals, auf die wir später noch ausführlich eingehen werden. Für ein einzelnes Bundesliga-Spiel fallen dabei leicht mehrere tausend Datenpunkte an, die erfasst, validiert und in strukturierte Formate überführt werden müssen. Der Haken: Solch detaillierte Daten sind teuer. Professionelle Datenanbieter wie Opta oder StatsBomb lassen sich ihre Dienste mit fünf- bis sechsstelligen Jahresbeträgen vergüten, was erklärt, warum viele kostenlose KI-Tools mit weniger umfangreichen Datensätzen arbeiten müssen und entsprechend ungenauere Vorhersagen liefern.

Neben den reinen Spieldaten fließen in fortgeschrittene Modelle auch Kontextinformationen ein, die über das hinausgehen, was während der neunzig Minuten auf dem Platz passiert. Dazu gehören Kaderinformationen wie aktuelle Verletzungen und Sperren, die Belastung durch englische Wochen oder Länderspielpausen sowie taktische Grundausrichtungen der Teams. Ein Team, das nach einem Champions-League-Auswärtsspiel mit Mitternachtslandung am Samstag gegen einen ausgeruhten Gegner antreten muss, startet unter anderen Voraussetzungen als in einer normalen Spielwoche. Manche Systeme berücksichtigen sogar Faktoren wie Wetterbedingungen – Regen, Wind, Kälte – oder Anreiseentfernungen, die bei internationalen Wettbewerben relevant werden können. Es gibt sogar Modelle, die versuchen, die historische Bedeutung bestimmter Begegnungen zu quantifizieren, etwa die besondere Brisanz eines Derbys oder die Wichtigkeit eines Abstiegskrimis für die Motivation der Spieler. Die Herausforderung besteht darin, diese heterogenen Informationen in ein einheitliches Format zu bringen, das der Algorithmus verarbeiten kann. Ein Trainerwechsel beispielsweise lässt sich nicht einfach als Zahl ausdrücken, kann aber erhebliche Auswirkungen auf die Spielweise eines Teams haben. Wie gewichtet man das? Und ab wann hat sich ein neuer Trainer eingearbeitet? Diese Fragen haben keine eindeutigen Antworten, und unterschiedliche Modelle gehen unterschiedlich damit um.

Expected Goals und andere Metriken: Die Sprache der Zahlen

Wer sich mit KI-Fußballvorhersagen beschäftigt, kommt um einen Begriff nicht herum: Expected Goals, kurz xG. Diese Kennzahl hat sich in den vergangenen Jahren von einem Nischenwerkzeug für Statistik-Nerds zu einem festen Bestandteil der Fußballberichterstattung entwickelt und ist mittlerweile auch im deutschen Mainstream angekommen. Selbst in der Sportschau werden mittlerweile xG-Werte eingeblendet, was vor zehn Jahren noch undenkbar gewesen wäre. Kommentatoren erwähnen die Metrik beiläufig, als wäre sie schon immer Teil der Fußballsprache gewesen. Doch was genau verbirgt sich hinter dieser Zahl, wie wird sie berechnet, und warum ist sie für KI-Modelle so wichtig? Zeit für eine gründliche Erklärung.

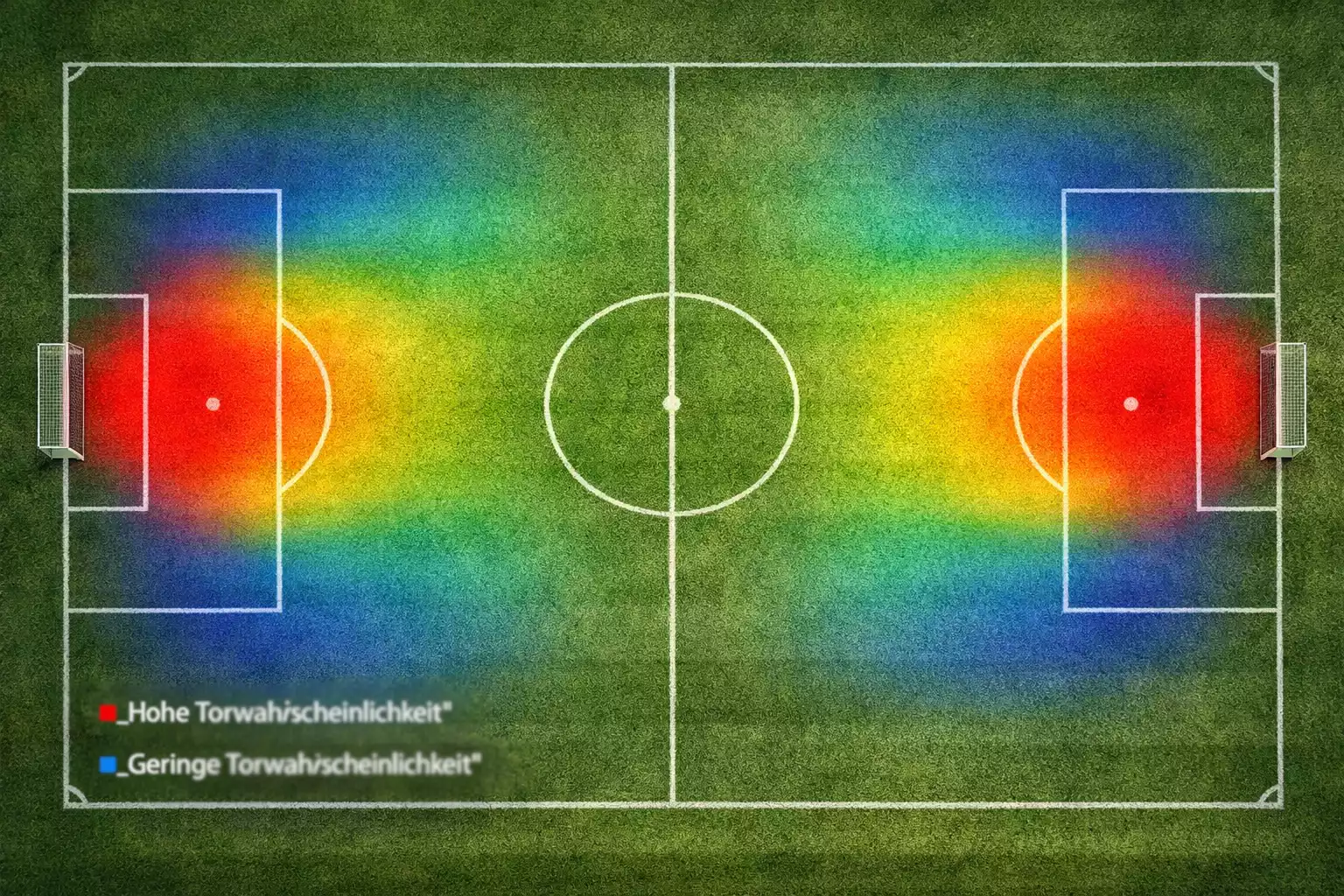

Das Grundprinzip ist schnell erklärt: Expected Goals messen die Qualität von Torchancen, nicht deren tatsächliche Verwertung. Jeder Schuss auf das Tor wird dabei anhand verschiedener Parameter bewertet – der Entfernung zum Tor, dem Winkel, der Spielsituation, ob ein Gegenspieler im Weg stand und so weiter. Aus diesen Faktoren errechnet sich eine Wahrscheinlichkeit, mit der ein durchschnittlicher Spieler diese Chance verwandeln würde. Ein Elfmeter hat beispielsweise einen xG-Wert von etwa 0,79, da historisch gesehen rund 79 Prozent aller Strafstöße im Tor landen. Ein Kopfball aus spitzem Winkel gegen den Torwart kommt vielleicht nur auf 0,08 xG. Die Summe aller xG-Werte eines Teams in einem Spiel zeigt dann an, wie viele Tore dieses Team aufgrund seiner Chancenqualität hätte erzielen müssen.

Der Wert dieser Metrik liegt auf der Hand: Sie filtert den Zufall heraus, der einzelne Spielergebnisse oft massiv verzerrt. Ein Team, das 0:1 verliert, obwohl es xG-Werte von 2,5 zu 0,3 hatte, wurde nicht etwa schwach gespielt – es hatte schlicht Pech in der Chancenverwertung. Der Stürmer, der sonst jedes zweite Mal trifft, hat an diesem Tag drei Großchancen vergeben; der Torwart des Gegners hatte den Tag seines Lebens; der einzige Schuss des Kontrahenten wurde vom Pfosten unhaltbar ins Tor abgefälscht. Solche Dinge passieren im Fußball ständig, und sie machen Endergebnisse zu unzuverlässigen Indikatoren für die tatsächliche Spielstärke. Umgekehrt kann ein 3:0-Sieg täuschen, wenn die xG-Bilanz knapp ausfiel und das siegreiche Team einfach klinisch effizient war, während der Gegner seine Chancen nicht nutzte. Für KI-Modelle sind solche Unterscheidungen Gold wert, denn sie erlauben Vorhersagen auf Basis der tatsächlichen Spielstärke statt der zufallsbehafteten Ergebnisse. Ein System, das nur Endresultate betrachtet, würde ein glücklich gewonnenes Spiel genauso werten wie einen verdienten Sieg – die xG-Analyse differenziert hier deutlich feiner und kommt damit näher an das heran, was auf dem Platz wirklich passiert ist.

Allerdings hat auch xG seine Grenzen, und diese werden in der öffentlichen Diskussion gerne übersehen. Die Metrik berücksichtigt nämlich nicht, wer den Schuss abgibt. Ein Chance mit 0,3 xG, die Erling Haaland bekommt, ist realistisch betrachtet mehr wert als dieselbe Chance für einen mittelmäßigen Zweitliga-Stürmer. Ebenso wenig fließt die Qualität des Torwarts auf der Gegenseite ein. Modelle, die diese Schwäche adressieren wollen, nutzen deshalb verfeinerte Metriken wie Post-Shot xG, das auch die Platzierung und Härte des Schusses berücksichtigt, oder spielerbezogene xG-Anpassungen. Die Interpretation von xG-Werten erfordert also durchaus Sachverstand – wer die Zahl blind als Wahrheit akzeptiert, versteht sie nicht richtig.

Neben xG existieren zahlreiche weitere fortgeschrittene Metriken, die in KI-Modellen Verwendung finden. Expected Assists (xA) messen die Qualität von Vorlagen unabhängig davon, ob sie tatsächlich zu Toren führen. Expected Points (xPTS) rechnen xG-Werte in erwartete Punkteausbeuten um. Expected Goals Against (xGA) betrachten die defensive Seite und zeigen, wie viele Gegentore ein Team aufgrund der zugelassenen Chancen hätte kassieren müssen. Besonders interessant für Wettinteressierte ist die Unterscheidung zwischen xG aus dem offenen Spiel (xGOP) und xG aus Standardsituationen (xGSP), da manche Teams bei Ecken und Freistößen überproportional gefährlich sind. All diese Kennzahlen zusammengenommen ergeben ein deutlich differenzierteres Bild der Spielstärke als traditionelle Statistiken wie Tore oder Punkte.

KI-Methoden im Vergleich: Von Machine Learning bis Deep Learning

Die Bandbreite der Methoden, die unter dem Label KI-Fußballvorhersage firmieren, ist beträchtlich. Um die Qualität verschiedener Angebote einschätzen zu können, hilft ein grundlegendes Verständnis der eingesetzten Technologien. Dabei gilt: Komplexer bedeutet nicht automatisch besser. Manchmal liefert ein simples, aber gut kalibriertes Modell zuverlässigere Ergebnisse als ein hochgezüchtetes neuronales Netz.

Am traditionellen Ende des Spektrums stehen statistische Modelle wie die Poisson-Regression. Diese Methode, benannt nach dem französischen Mathematiker Siméon Denis Poisson, modelliert die Anzahl erwarteter Tore als Wahrscheinlichkeitsverteilung. Die Grundidee: Tore im Fußball sind relativ seltene Ereignisse, die einer bestimmten statistischen Verteilung folgen. Kennt man die durchschnittliche Torerwartung eines Teams, lässt sich daraus ableiten, mit welcher Wahrscheinlichkeit es null, eins, zwei oder mehr Tore schießt. Das Schöne an Poisson-Modellen ist ihre Interpretierbarkeit – man versteht genau, was das Modell tut. Der Nachteil: Sie erfassen nur lineare Zusammenhänge und können komplexere Wechselwirkungen nicht abbilden.

Einen Schritt weiter gehen maschinelle Lernverfahren wie Random Forests oder Gradient Boosting. Diese Algorithmen bauen Entscheidungsbäume auf, die Daten schrittweise nach verschiedenen Kriterien aufteilen. Ein Random Forest etwa erstellt Hunderte solcher Bäume mit jeweils leicht unterschiedlichen Eingangsdaten und kombiniert deren Vorhersagen. Das Ergebnis ist robuster gegen Ausreißer und kann auch nichtlineare Zusammenhänge erkennen. Wenn beispielsweise hoher Ballbesitz nur dann positiv wirkt, wenn das gegnerische Team ebenfalls offensiv spielt, kann ein solches Modell dieses Muster theoretisch lernen. Die Herausforderung liegt im sogenannten Feature Engineering – der Kunst, die richtigen Eingangsvariablen zu definieren und aufzubereiten.

Neuronale Netze und Deep Learning bilden die Königsklasse der KI-Methoden, zumindest was die Komplexität und den technischen Anspruch angeht. Diese Systeme ahmen in stark vereinfachter Form die Funktionsweise des menschlichen Gehirns nach, indem sie Daten durch mehrere Schichten künstlicher Neuronen leiten. Jede Schicht extrahiert dabei abstraktere Merkmale aus den Eingangsdaten, und am Ende steht idealerweise eine Vorhersage, die alle relevanten Zusammenhänge berücksichtigt. Was für Bildererkennung oder Sprachverarbeitung sensationelle Ergebnisse liefert – man denke an Gesichtserkennung oder automatische Übersetzungen –, ist im Fußballkontext allerdings mit Vorsicht zu genießen. Neuronale Netze benötigen enorme Datenmengen zum Training. Selbst die umfangreichsten Fußballdatenbanken sind im Vergleich zu den Milliarden Bildern, mit denen Bilderkennungssysteme trainiert werden, geradezu winzig. Eine Bundesliga-Saison hat 306 Spiele; selbst wenn man zwei Jahrzehnte europäischen Spitzenfußball zusammennimmt, kommt man auf vielleicht hunderttausend Partien. Für Deep Learning ist das nicht viel. Die Gefahr des Overfitting, also des übermäßigen Anpassens an historische Daten ohne echte Vorhersagekraft für neue Spiele, ist bei dieser Methode besonders groß.

Ein relativ neuer Trend ist die Nutzung großer Sprachmodelle für Fußballprognosen. ChatGPT, Claude und vergleichbare Systeme können tatsächlich sinnvolle Analysen erstellen, wenn man sie mit den richtigen Daten versorgt. Ihre Stärke liegt in der Fähigkeit, verschiedene Informationsquellen zu kombinieren und kontextabhängig zu gewichten. Man kann ihnen beispielsweise Statistiken zusammen mit qualitativen Informationen wie Verletzungsmeldungen oder Trainerzitaten geben und erhält eine zusammenhängende Einschätzung. Der fundamentale Schwachpunkt bleibt jedoch bestehen: Diese Modelle haben kein eigenes Wissen über aktuelle Spielstände oder Kader. Sie können nur das verarbeiten, was man ihnen gibt, und ihre Aussagen über Fakten sollte man stets überprüfen. Als Ergänzung zu datenbasierten Systemen können sie wertvoll sein, als alleinige Grundlage für Wettentscheidungen sind sie zu unzuverlässig.

Die Praxis: Wie eine KI-Prognose entsteht

Die Theorie ist das eine, die praktische Umsetzung das andere. Wie läuft die Erstellung einer KI-Fußballvorhersage konkret ab? Um das zu verstehen, folgen wir dem Weg von den Rohdaten bis zur fertigen Prognose. Dieser Prozess ist aufwendiger, als es die schicken Oberflächen der meisten Vorhersageportale vermuten lassen.

Alles beginnt mit der Datenbeschaffung und -aufbereitung, die oft den größten Teil der Arbeit ausmacht. Rohdaten liegen selten in dem Format vor, das ein Algorithmus benötigt. Spielergebnisse müssen mit Kaderinformationen verknüpft, fehlende Werte behandelt und Ausreißer identifiziert werden. Ein typisches Problem: Wie geht man mit Teams um, die in der Vorsaison noch gar nicht in der Liga gespielt haben? Oder mit Spielern, die mitten in der Saison den Verein wechseln? Diese scheinbar banalen Fragen können erheblichen Einfluss auf die Modellqualität haben. Professionelle Anbieter beschäftigen ganze Teams nur für die Datenpflege.

Der nächste Schritt ist das Feature Engineering, also die Auswahl und Konstruktion der Eingangsvariablen. Hier trennt sich oft die Spreu vom Weizen. Ein naiver Ansatz würde einfach alle verfügbaren Statistiken in den Algorithmus werfen und hoffen, dass dieser selbst herausfindet, was relevant ist. Das funktioniert selten gut. Stattdessen müssen die Features sorgfältig ausgewählt werden: Welcher Zeitraum ist für die Formberechnung optimal – die letzten drei, fünf oder zehn Spiele? Sollen Heim- und Auswärtsspiele getrennt betrachtet werden? Wie gewichtet man Spiele gegen starke versus schwache Gegner? Diese Entscheidungen basieren auf Erfahrung, Domänenwissen und nicht zuletzt Experimentierfreude.

Das eigentliche Modelltraining nimmt im Vergleich zur Datenaufbereitung oft überraschend wenig Zeit in Anspruch – die Rechenleistung moderner Computer macht es möglich. Man füttert den Algorithmus mit historischen Daten, bei denen das Ergebnis bereits bekannt ist, und lässt ihn Muster lernen. Der Computer probiert gewissermaßen verschiedene Gewichtungen und Zusammenhänge aus, bis er eine Kombination findet, die die Trainingsdaten gut erklärt. Entscheidend ist dabei die Validierung: Man darf nicht die gesamten Daten zum Training verwenden, sondern muss einen Teil zurückhalten, um die Vorhersagekraft auf neuen, ungesehenen Daten zu testen. Ein Modell, das die Trainingsdaten perfekt beschreibt, aber bei neuen Spielen versagt, ist nutzlos – schlimmer noch, es täuscht eine Zuverlässigkeit vor, die nicht existiert. Seriöse Anbieter führen daher sogenanntes Backtesting durch, bei dem sie simulieren, wie ihr Modell in vergangenen Saisons abgeschnitten hätte, wenn es nur die damals verfügbaren Informationen gehabt hätte. Erst wenn diese historische Simulation überzeugt, wird das Modell für echte Vorhersagen eingesetzt.

Nach dem Training beginnt der Produktivbetrieb. Vor jedem Spieltag werden die aktuellen Daten eingespeist, und das Modell berechnet Wahrscheinlichkeiten für verschiedene Ausgänge. Diese Rohwerte durchlaufen typischerweise noch eine Nachbearbeitung: Offensichtliche Fehler werden korrigiert, Edge Cases behandelt, und manchmal fließen auch menschliche Einschätzungen ein. Das Ergebnis ist dann die Prognose, die auf der Website oder in der App erscheint – oft mit einer vermeintlichen Präzision auf mehrere Nachkommastellen, die angesichts der inhärenten Unsicherheit eher irreführend als informativ ist. Die ehrlichsten Systeme geben neben der Punktprognose auch Konfidenzintervalle an, die verdeutlichen, wie unsicher die Schätzung eigentlich ist.

Tools und Plattformen: Der Markt der KI-Vorhersagen

Der Markt für KI-gestützte Fußballvorhersagen ist in den vergangenen Jahren regelrecht explodiert, was Segen und Fluch zugleich ist. Von kostenlosen Webseiten über Smartphone-Apps bis hin zu Premium-Diensten mit monatlichen Abogebühren reicht das Spektrum der Angebote. Die Qualität variiert dabei erheblich, und nicht jeder Anbieter, der KI auf seiner Startseite in großen Lettern verspricht, nutzt tatsächlich nennenswerte künstliche Intelligenz. Manches, was als revolutionäre KI-Technologie vermarktet wird, entpuppt sich bei näherem Hinsehen als simples Tabellenranking mit ein paar Extrakriterien. Die Intransparenz der Branche macht es schwer, die Spreu vom Weizen zu trennen.

Im deutschsprachigen Raum haben sich einige Plattformen etabliert, die regelmäßig KI-basierte Tipps liefern. Dienste wie Wettbasis setzen den Supercomputer BETSiE ein, der für jeden Bundesliga-Spieltag Prognosen erstellt und diese auch transparent mit Trefferquoten dokumentiert. Internationale Anbieter wie Predicd oder FootballAnt bieten breitere Ligaabdeckung, arbeiten aber mit unterschiedlichen Methoden und Datenquellen. Die größte Herausforderung für Nutzer liegt darin, seriöse Angebote von Scharlatanerie zu unterscheiden. Ein paar Leitfragen helfen bei der Einordnung: Wird offengelegt, welche Methoden zum Einsatz kommen? Gibt es nachprüfbare Trefferbilanzen über längere Zeiträume? Werden Vorhersagen vor oder erst nach den Spielen veröffentlicht?

Bei der Bewertung von KI-Tools sollte man realistische Erwartungen haben. Trefferquoten von 55 bis 65 Prozent bei der Vorhersage des Spielausgangs sind als gut zu bewerten. Wer höhere Werte verspricht, ist entweder unehrlich oder misst nach anderen Kriterien. Wichtiger als die reine Trefferquote ist ohnehin die Frage, ob ein System Value identifizieren kann – also Fälle, in denen die berechnete Wahrscheinlichkeit höher liegt als die von den Buchmacherquoten implizierte. Ein Tool, das zuverlässig überbewertete Außenseiter findet, ist wertvoller als eines mit hoher Trefferquote bei Favoriten zu Miniquoten.

Kostenlose Angebote haben naturgemäß Einschränkungen. Oft ist die Ligaabdeckung begrenzt, die Daten weniger aktuell, oder es fehlen fortgeschrittene Features wie personalisierte Benachrichtigungen. Für Gelegenheitsnutzer, die sich primär für die großen europäischen Ligen interessieren, können kostenlose Dienste dennoch ausreichend sein. Wer tiefer einsteigen möchte, findet bei Premium-Anbietern umfangreichere Daten, mehr Wettmärkte und häufig auch Zusatzfunktionen wie Quotenvergleiche oder Bankroll-Tracking. Die monatlichen Kosten liegen typischerweise zwischen zehn und fünfzig Euro, wobei der höhere Preis nicht automatisch bessere Qualität garantiert.

Ein Sonderfall sind Apps, die KI-Vorhersagen mit Wettplatzierung verbinden. Solche Systeme analysieren nicht nur Spiele, sondern können auch direkt Wetten bei angebundenen Buchmachern platzieren. Die Idee eines vollautomatisierten Wettroboters klingt verlockend, birgt aber erhebliche Risiken. Abgesehen von der technischen Komplexität ist völlig unklar, wie Buchmacher auf solche Praktiken reagieren – Kontosperrungen wegen auffälligen Wettverhaltens sind keine Seltenheit. Wer diesen Weg gehen möchte, sollte sich der rechtlichen und praktischen Fallstricke bewusst sein.

Chancen und Grenzen: Was die KI kann – und was nicht

Nach all den technischen Erläuterungen stellt sich die entscheidende Frage: Taugt KI-gestützte Vorhersage im Fußball tatsächlich etwas, oder ist das alles nur ein elaborierter Marketing-Gag? Die ehrliche Antwort lautet: Es kommt darauf an. Die Technologie bietet echte Vorteile gegenüber rein menschlicher Analyse, hat aber auch fundamentale Grenzen, die sich nicht einfach wegrechnen lassen. Wer diese Grenzen ignoriert, wird früher oder später eine teure Lektion in Sachen Demut lernen.

Der größte Vorteil von KI liegt in ihrer Fähigkeit, große Datenmengen systematisch und emotionslos zu verarbeiten. Ein Mensch kann unmöglich alle relevanten Statistiken zu allen Spielen einer Saison im Kopf behalten und konsistent gewichten. Wir neigen dazu, uns an besonders eindrucksvolle Spiele zu erinnern und gewöhnliche zu vergessen; wir überbewerten jüngste Ereignisse gegenüber älteren; wir lassen uns von Sympathien und Antipathien beeinflussen. Die KI macht nichts davon. Sie vergisst nichts, macht keine Rechenfehler und lässt sich nicht von irrelevanten Eindrücken beeinflussen – der Star mit der teuren Frisur bekommt keine Extrapunkte, und der graue Mittelfeldspieler wird nicht unterschätzt, nur weil er selten in den Schlagzeilen steht. Das klingt nach einem unschlagbaren Vorteil, ist aber nur die halbe Wahrheit. Denn die KI kann nur verarbeiten, was in Daten erfasst ist – und vieles, was auf dem Fußballplatz passiert, entzieht sich der Quantifizierung. Die Anspannung vor einem Abstiegsduell, die Motivation nach einer öffentlichen Trainerschelte, die subtilen Verschiebungen in der Mannschaftsdynamik nach einem Kabinenkrach, die besondere Bedeutung eines Spiels für einen einzelnen Spieler: All das bleibt für den Algorithmus unsichtbar, kann aber den Unterschied zwischen Sieg und Niederlage ausmachen.

Ein häufig übersehenes Problem ist die Effizienz des Wettmarkts, die viele Hobbytipper systematisch unterschätzen. Buchmacher sind keine Amateure; sie nutzen selbst hochentwickelte Modelle zur Quotenberechnung und passen ihre Linien kontinuierlich an eingehende Wettvolumina an. Die größten Wettanbieter beschäftigen Teams von Mathematikern und Data Scientists, deren einzige Aufgabe darin besteht, Quoten möglichst präzise zu kalkulieren. Das bedeutet: Selbst wenn eine KI korrekt vorhersagt, dass Bayern München mit 70-prozentiger Wahrscheinlichkeit gewinnt, ist diese Information nur dann wertvoll, wenn die Quote mehr als 1,43 beträgt. In der Praxis spiegeln die Quoten die tatsächlichen Wahrscheinlichkeiten erstaunlich genau wider, was es schwer macht, systematisch Value zu finden. Die Marge des Buchmachers – also der eingebaute Prozentsatz, der sicherstellt, dass das Haus auf Dauer gewinnt – tut ihr Übriges. Wer langfristig profitabel wetten will, muss nicht nur besser vorhersagen als der Zufall, sondern besser als der Markt. Das ist eine deutlich höhere Hürde, an der die allermeisten scheitern.

Hinzu kommt das Problem der Überanpassung. KI-Modelle, die auf historischen Daten trainiert werden, neigen dazu, Muster zu finden, die in der Vergangenheit zufällig auftraten, aber keine echte Vorhersagekraft haben. Ein Klassiker ist die Überbewertung kleiner Stichproben: Wenn Team X seine letzten drei Heimspiele gegen Team Y gewonnen hat, bedeutet das statistisch so gut wie nichts – die Varianz im Fußball ist einfach zu hoch. Unseriöse Anbieter nutzen solche Scheinkorrelationen gerne für plakative Tipps. Seriöse Modelle versuchen, dem durch strenge Validierung entgegenzuwirken, eliminieren können sie das Problem aber nicht vollständig.

Trotz all dieser Einschränkungen haben KI-gestützte Analysen ihre Berechtigung. Sie können helfen, offensichtliche Fehleinschätzungen zu vermeiden – etwa wenn ein Team aufgrund eines unglücklichen Ergebnisses unterschätzt wird, obwohl die zugrunde liegende Leistung gut war. Sie können auf Faktoren aufmerksam machen, die man selbst übersehen hätte. Und sie bieten eine systematische Grundlage, um eigene Einschätzungen zu überprüfen. Wer KI als Werkzeug versteht und nicht als unfehlbares Orakel, kann durchaus davon profitieren. Die Erwartung, mit einem KI-Tool reich zu werden, ist hingegen naiv – wäre es so einfach, würden die Entwickler ihre Systeme kaum für ein paar Euro monatlich verkaufen.

Strategischer Einsatz: KI-Tipps sinnvoll nutzen

Wie lässt sich KI-gestützte Analyse nun konkret in eine Wettstrategie integrieren? Die Antwort hängt stark davon ab, welche Ziele man verfolgt und wie viel Zeit man investieren möchte. Eines vorweg: Wer glaubt, mit blind übernommenen KI-Tipps dauerhaft gewinnen zu können, wird unweigerlich enttäuscht werden. Die Technologie entfaltet ihren Wert erst in Kombination mit eigenem Nachdenken, kritischer Prüfung und einem Verständnis dafür, was die Zahlen eigentlich bedeuten.

Ein sinnvoller Einstieg ist die Nutzung von KI als Recherche-Werkzeug, nicht als Entscheidungsautomat. Bevor man sich mit einem Spiel beschäftigt, kann ein Blick auf die KI-Vorhersage einen ersten Orientierungspunkt geben, eine Art Ausgangshypothese, die man dann überprüft. Weicht die eigene Einschätzung stark von der KI-Prognose ab, lohnt sich die Frage, warum das so ist. Vielleicht hat man relevante Informationen übersehen, die das System berücksichtigt hat – eine Verletzung, eine Sperre, einen taktischen Trend. Oder aber die KI liegt falsch, weil sie einen aktuellen Faktor nicht berücksichtigt hat, der sich in den Daten noch nicht widerspiegelt – einen frisch verpflichteten Spieler, einen Motivationsschub durch ein Jubiläum, einen internen Konflikt. Dieser Dialog zwischen menschlicher Intuition und maschineller Analyse kann die Qualität der eigenen Entscheidungen deutlich verbessern. Das setzt allerdings voraus, dass man die KI-Vorhersagen nicht als Wahrheit akzeptiert, sondern kritisch hinterfragt und mit dem eigenen Wissen abgleicht.

Fortgeschrittene Nutzer können KI-Systeme für systematisches Value-Betting einsetzen. Die Idee dahinter ist bestechend einfach: Man vergleicht die von der KI berechneten Wahrscheinlichkeiten mit den Buchmacherquoten und setzt nur dann, wenn die KI einen deutlichen Vorteil sieht. Liegt die berechnete Siegwahrscheinlichkeit bei 60 Prozent, die Quote aber bei 2,0 (was implizit nur 50 Prozent unterstellt), deutet das auf Value hin – die Wette ist langfristig profitabel, selbst wenn sie im Einzelfall verliert. In der Praxis ist dieser Ansatz allerdings deutlich anspruchsvoller, als er auf dem Papier klingt. Man benötigt zunächst ein zuverlässiges KI-System, dessen Wahrscheinlichkeiten gut kalibriert sind. Man muss die Marge der Buchmacher einkalkulieren, die jeden errechneten Vorteil schmälert. Und man braucht eiserne Disziplin, um auch bei unvermeidlichen Verlustserien nicht vom Plan abzuweichen oder die Einsätze emotional zu erhöhen. Die erwarteten Renditen sind zudem bescheiden – selbst erfolgreiche professionelle Wetter, die das Ganze hauptberuflich betreiben, erreichen selten mehr als fünf bis zehn Prozent Rendite auf ihren Umsatz. Reich wird man damit nicht über Nacht.

Ein oft vernachlässigter Aspekt ist das Bankroll-Management, das für langfristigen Erfolg mindestens so wichtig ist wie gute Vorhersagen. Selbst die beste Prognose nutzt nichts, wenn man seinen Einsatz nicht kontrolliert. Die Mathematik dahinter ist eindeutig und unbarmherzig: Wer seinen gesamten Wetteinsatz auf eine einzelne Prognose setzt, wird früher oder später alles verlieren – egal wie gut das System ist. Denn auch bei einer Trefferquote von 60 Prozent bedeutet das, dass vier von zehn Wetten verloren gehen, und irgendwann kommen diese Verluste in Serie. Seriöse Strategien arbeiten daher mit festen Einsatzgrößen – typischerweise ein bis drei Prozent des Gesamtbudgets pro Wette – oder dem Kelly-Kriterium, das den mathematisch optimalen Einsatz aus Wahrscheinlichkeit und Quote berechnet. KI kann hier unterstützen, indem sie neben der Punktprognose auch Konfidenzintervalle liefert, die anzeigen, wie sicher die Schätzung ist. Bei unsicheren Vorhersagen setzt man weniger, bei sicheren entsprechend mehr. In der Realität scheitern viele Wetter nicht an schlechten Tipps, sondern an mangelnder Disziplin beim Geldmanagement – sie erhöhen die Einsätze nach Verlusten, jagen verlorenen Wetten hinterher oder setzen impulsiv auf Bauchgefühl, wenn die KI-Empfehlungen nicht ihren Erwartungen entsprechen.

Abschließend sei betont: Sportwetten bleiben ein Glücksspiel, und keine noch so ausgefeilte KI ändert daran etwas Grundsätzliches. Die Technologie kann helfen, informiertere Entscheidungen zu treffen und grobe Fehleinschätzungen zu vermeiden, aber sie garantiert keine Gewinne. Wer mit dem Gedanken spielt, auf Basis von KI-Vorhersagen ernsthaft und regelmäßig zu wetten, sollte sich seiner Risikotoleranz bewusst sein und vor allem nie mit Geld spielen, dessen Verlust er nicht verschmerzen kann. Die Geschichten von Menschen, die mit Sportwetten reich geworden sind, füllen Bücher; die Geschichten derer, die dabei alles verloren haben, würden Bibliotheken füllen. Als Unterhaltung und intellektuelle Herausforderung haben KI-gestützte Analysen durchaus ihren Reiz. Sie können Fußball aus einer neuen Perspektive zeigen und zum Nachdenken anregen. Als vermeintlich sichere Einkommensquelle oder gar als Ausweg aus finanziellen Problemen sind sie jedoch der falsche Ansatz – das gilt für jede Form von Sportwetten, KI hin oder her.

Häufig gestellte Fragen

Wie zuverlässig sind KI-Fußballvorhersagen wirklich?

Die Zuverlässigkeit von KI-Fußballvorhersagen hängt stark vom jeweiligen System und der betrachteten Liga ab. Seriöse Anbieter erreichen Trefferquoten zwischen 50 und 65 Prozent bei der Vorhersage des Spielausgangs, was angesichts von drei möglichen Ergebnissen (Heimsieg, Unentschieden, Auswärtssieg) deutlich über dem Zufallsniveau von etwa 33 Prozent liegt. Allerdings sagt die reine Trefferquote wenig über die Profitabilität aus, da auch die jeweiligen Quoten eine entscheidende Rolle spielen. Entscheidend ist vielmehr, ob ein System Value-Wetten identifizieren kann, bei denen die berechnete Wahrscheinlichkeit über der von den Quoten implizierten liegt. Pauschale Aussagen zur Zuverlässigkeit sind schwierig, da die Qualität zwischen verschiedenen Anbietern erheblich variiert. Empfehlenswert ist, die dokumentierte Langzeit-Performance eines Systems über mindestens eine volle Saison zu prüfen, bevor man darauf vertraut. Kurzfristige Erfolgsserien können auch Zufall sein.

Welche Daten analysiert eine Fußball-KI für ihre Prognosen?

Moderne KI-Systeme verarbeiten eine breite Palette von Daten. Die Grundlage bilden historische Spieldaten wie Ergebnisse, Torschützen und Spielstatistiken. Darauf aufbauend fließen detaillierte Metriken wie Expected Goals, Ballbesitz, Passgenauigkeit und Schussdaten ein. Fortgeschrittene Modelle berücksichtigen zusätzlich Kaderinformationen, aktuelle Verletzungen, Sperren, taktische Formationen und historische Direktvergleiche. Manche Systeme integrieren sogar externe Faktoren wie Wetterbedingungen oder Anreiseentfernungen. Die Qualität der Datenquelle ist entscheidend für die Vorhersagegüte – professionelle Datenanbieter liefern präzisere Informationen als frei verfügbare Statistiken, sind aber entsprechend kostspielig.

Gibt es kostenlose KI-Tools für Fußballvorhersagen?

Ja, der Markt bietet verschiedene kostenlose Optionen für KI-Fußballvorhersagen. Plattformen wie Predicd oder FootballAnt stellen Basisprognosen ohne Registrierung bereit. Auch allgemeine Sprachmodelle wie ChatGPT können mit entsprechenden Eingaben für Fußballanalysen genutzt werden, wobei deren Echtzeit-Datenlage begrenzt ist. Die Einschränkungen kostenloser Dienste liegen typischerweise in der Ligaabdeckung, der Datenaktualität und dem Funktionsumfang. Für gelegentliche Nutzung und Fokus auf große europäische Ligen sind Gratisangebote oft ausreichend. Wer umfangreichere Analysen, mehr Wettmärkte oder Zusatzfunktionen benötigt, findet bei Premium-Diensten entsprechende Angebote gegen monatliche Gebühren.